隨著人工智能(AI)技術的極速發展,它正在重塑我們的生活、工作和社會結構。然而,這些技術的廣泛應用也引發了對倫理和道德問題的深刻關注。人工智能倫理(AI Ethics)成為一個關鍵領域,旨在確保AI技術在創新過程中不僅追求效率和效益,還要遵循倫理原則。本文將探討人工智能倫理的核心議題,包括公平性與偏見、隱私、透明度,人類價值觀等諸多議題。

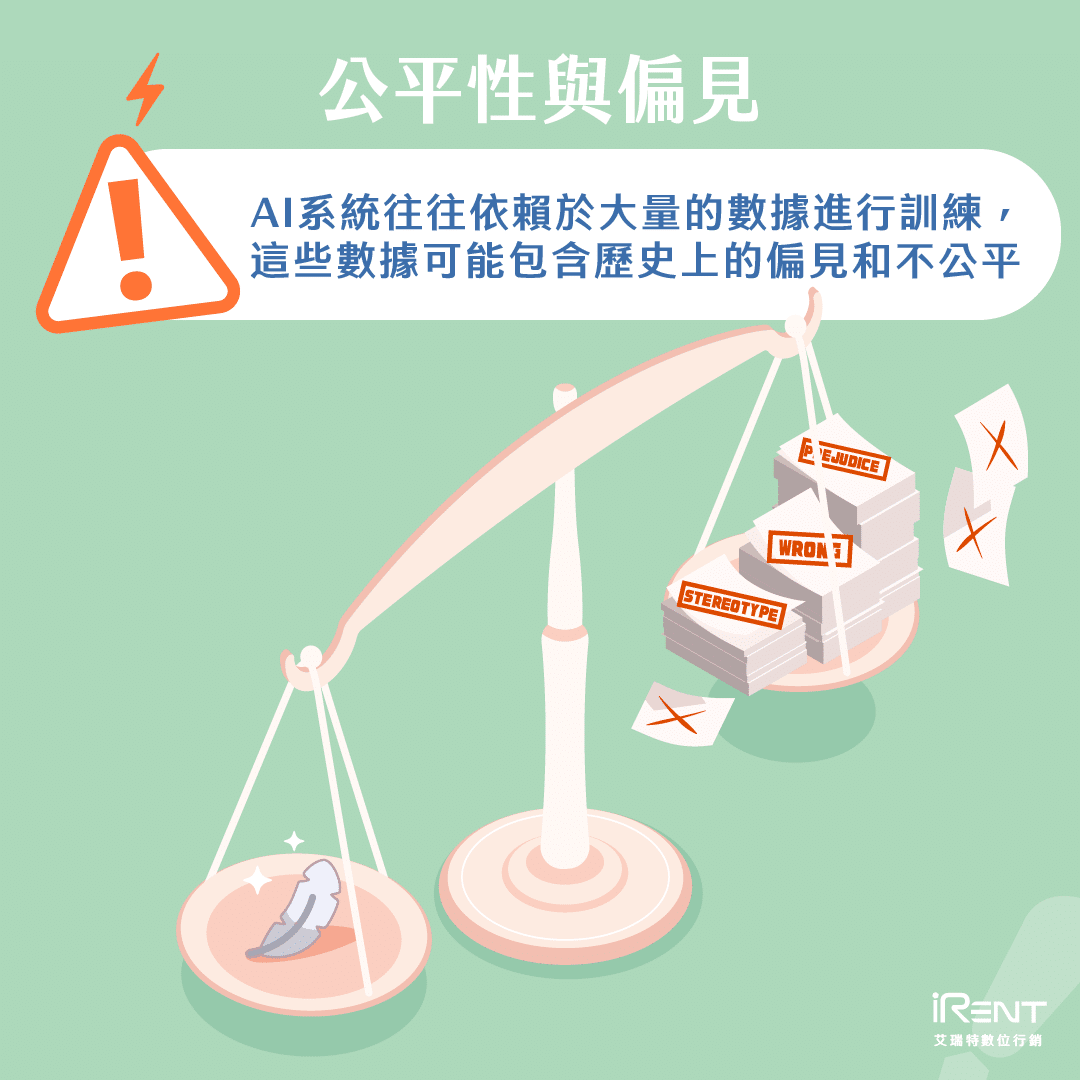

一、公平性與偏見

人工智能系統的公平性是人工智能倫理的核心問題之一。AI系統往往依賴於大量的數據進行訓練,這些數據可能包含歷史上的偏見和不公平。比如,在招聘過程中使用的AI系統如果訓練數據中存在性別或種族偏見,可能會導致不公平的招聘結果。這種情況不僅損害了求職者的公平權利,也可能進一步加劇社會不平等。為了應對這一問題,研究者們正在探索各種技術方法來檢測和減少AI系統中的偏見,如公平性評估工具和偏見校正算法。

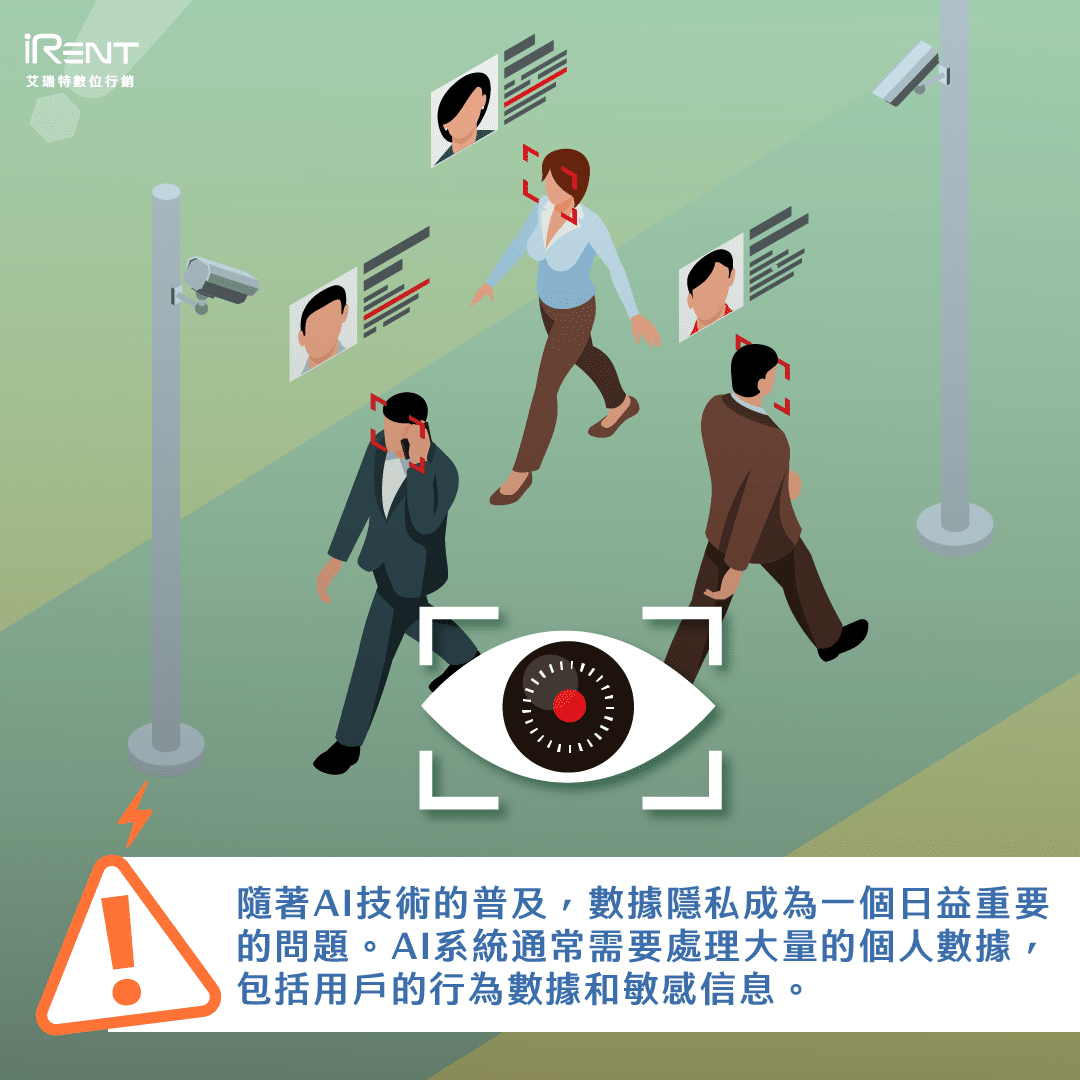

二、隱私

隨著AI技術的普及,數據隱私成為一個日益重要的問題。AI系統通常需要處理大量的個人數據,包括用戶的行為數據和敏感信息。這些數據的收集、存儲和處理必須遵循隱私保護原則。例如,《一般數據保護條例》(GDPR)和《加州消費者隱私法》(CCPA)等法律規範了如何收集和使用個人數據,要求企業在處理用戶數據時必須獲得明確的同意並提供透明的信息。人工智能倫理研究致力於確保AI系統遵守這些隱私規範,並探討如何在保障隱私的同時充分發揮AI技術的潛力。

三、透明度

AI系統的透明度涉及到系統的運作原理和決策過程。許多AI系統,特別是深度學習模型,其內部運作過於複雜,對用戶而言缺乏透明度。這種情況可能導致用戶對AI系統的決策過程缺乏理解,從而影響系統的信任度。提高AI系統的可解釋性是人工智能倫理中的一個重要方向。研究者們正致力於開發可解釋AI模型和技術,如可視化工具和解釋性算法,以幫助用戶理解AI系統的決策邏輯和過程。

四、責任與問責

當AI系統做出錯誤決策或造成損害時,誰應承擔責任?這涉及到AI系統的開發者、使用者和運營者的法律和道德責任。例如,在自駕車發生事故的情況下,責任應該由車輛製造商、軟體開發商還是車主承擔?人工智能倫理關注這些問題,並致力於建立清晰的責任框架和法律規範,以確保在AI系統出現問題時,受害者能夠獲得適當的賠償和救濟。

五、自主權與控制

AI系統的自主性越來越強,尤其是在自駕車和無人機等應用中。這些系統在執行任務時可能會面臨複雜的情境和決策問題,如何平衡系統的自主性和人類的控制權是人工智能倫理的重要議題。如何確保AI系統在自主運行時不會侵犯人類的基本權利或自由?這需要在設計AI系統時充分考慮人類的干預和控制機制,以確保技術的安全和可靠。

六、武器化

AI技術的武器化是人工智能倫理面臨的另一個重大挑戰。自動化武器和AI輔助的軍事技術可能改變戰爭的性質和規模。這些技術的使用可能引發對國際法和人道法的關注,例如,如何確保自動化武器在戰爭中不會違反人道原則?如何防止這些技術被濫用?這些問題需要國際社會共同努力,制定相應的法律和規範,以確保AI技術在軍事領域的合法使用。

七、工作與經濟影響

AI技術的快速發展對就業市場和經濟結構產生了深遠的影響。自動化技術可能會取代一些傳統工作崗位,這對勞動力市場和經濟穩定性構成挑戰。如何應對這些變化,提供再培訓機會,並減少技術帶來的經濟不平等,是人工智能倫理中的一個重要課題。政策制定者和企業需要共同努力,確保技術發展能夠促進社會和經濟的可持續發展。

八、人類價值觀

AI系統的設計和運作應該體現什麼樣的人類價值觀?這涉及到AI系統如何支持和增強人類的福祉,而不是僅僅追求效率或利潤。人工智能倫理研究者們正致力於確保AI技術能夠反映人類的核心價值觀,如尊重、平等和人權,並在技術應用中促進人類的整體福祉。

九、長期風險

AI技術的長期風險是另一個值得關注的問題。隨著強人工智能(AGI)和超人工智能(ASI)的可能性逐漸接近,這些技術可能會對人類文明和社會結構產生深遠的影響。如何預測和管理這些長期風險,確保技術發展不會對人類造成不可逆轉的損害,是人工智能倫理研究的重要課題。

結論

人工智能倫理作為一個新興領域,涉及到許多複雜而深刻的問題。隨著技術的發展,我們需要不斷更新和完善倫理原則和法律規範,以應對不斷變化的挑戰。對於AI技術的開發者、企業和政策制定者來說,理解和應用人工智能倫理原則,是確保技術發展能夠惠及全人類的關鍵。只有在道德和倫理的指導下,AI技術才能真正實現其潛力,並在促進社會進步和人類福祉的過程中發揮積極作用。